2020-4-2

一、面临问题

数据科学家利用深度学习和分析的强大能力,并依靠计算性能来更快地获得见解并进行创新。GPU 技术是提供通往 AI 的更快途径,但是建立人工智能深度学习平台远不止部署服务器和 GPU 这么简单。AI 和深度学习要求在软件工程方面投入大量精力,因为这需要集成复杂的组件及软件堆栈,其中包括框架、库和驱动程序。完成部署后,在您等待不断升级的开源软件变稳定的过程中,也需要不断投入额外的时间和资源。您还需要优化基础架构以提高性能,而管理成本会随着系统规模的扩大而增加。

二、解决方案

NVIDIA DGX 系列产品就是通过开箱即用的解决方案来加快实施您的 AI 计划,您可以在几小时而非数月内完成AI深度学习平台的部署。NVIDIA NGC 是 GPU 优化的深度学习、机器学习和 HPC 软件中心,可以处理所有线路,因此数据科学家、开发人员和研究人员可以专注于构建解决方案,收集各种见解并提供业务价值。

三、产品介绍

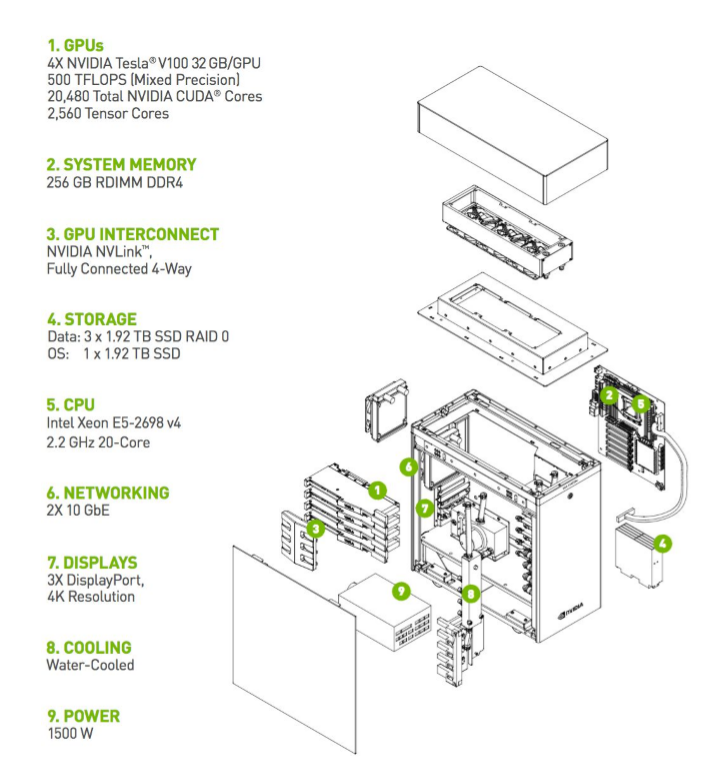

1. NVIDIA DGX-Station

NVIDIA DGX-Station 工作站是面向 AI 开发前沿的个人超级计算机,而且是唯一一款配备四块 NVIDIA Tesla V100 Tensor Core GPU 的工作站,它集成全连接的四路 NVLink 架构,可提供 500 tera FLOPS 的 AI 性能,能够提高您整个团队的实验速度、迭代次数,轻松获得工作成果。DGX-Station 内置经全栈优化的硬件和软件解决方案,让您的数据科学团队在短短一小时内就能轻松上手,并且是一款水冷式静音工作站,提供便于办公的软件包,其中的数据中心便拥有计算能力,既能不断运行实验,又能提高团队效率。下图显示了 DGX-Station 的系统组件:

这一突破性解决方案具有如下优势:

1)相较基于 CPU 的服务器,深度学习训练性能高达 50 倍;

2)相较 20 节点的 Spark 服务器集群,大型数据集分析提速 100 倍;

3)相较采用 PCIE,采用 NVLink 技术带宽增加 5 倍;

4)在深度学习训练方案实现超强通用性,每秒可以推理 30000 多张图像。

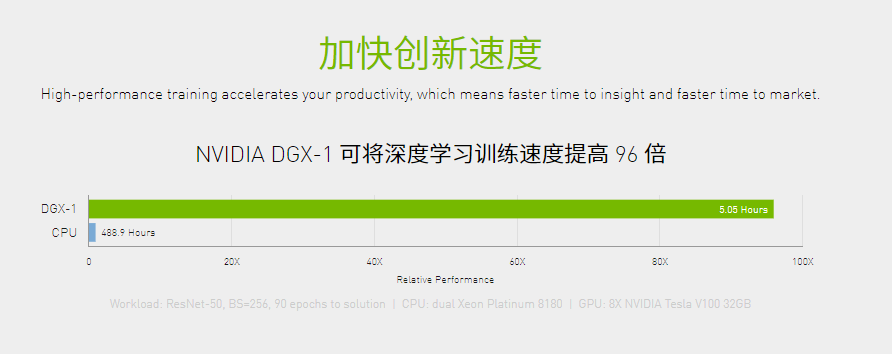

2. NVIDIA DGX-1

NVIDIA DGX-1 系统配有 8 个NVIDIA® Tesla® V100 GPU 加速器,在混合立体网络中通过 NVIDIA®NVLink™(NVIDIA高性能 GPU 互联技术)互相连接。DGX-1 可搭配两个Intel Xeon CPU 及四块 100Gb InfiniBand 网络适配器,为深度学习训练提供惊人的强大性能。

此外,DGX-1 系统软件、强大的库和 NVLink 网络为扩充至八个 Tesla V100 GPU 而进行优化,可以在生产环境和研究环境中,为开发和部署深度学习应用提供最大的灵活性和更高的性能。

DGX-1 产品优势

DGX-1 采用目前最新的 Docker 容器技术,深度学习技术框架(Deep Learning)和 NVLink 等技术。提供高可用、可扩展、高带宽的一体化集群解决方案,并且该产品在 AI、工业制造、教育、医疗、科研等企业单位,拥有成熟的成功案例。可以帮助客户快速创新和迭代,以低成本的投入,获取高收益的产出,从而提高生产产出率。

帮助用户在实际的高性能计算应用场景下提高生产效率,快速的完成数据分析,缩短上市时间。

如今的深度学习环境在软件设计方面耗费的时间价值可达数十万美元,而开源软件需要数月时间才能变得稳定。借助 DGX-1 您可以立刻提高效率。简化工作流程并于团队开展协作。利用配有 NVIDIA 的随时更新的优化软件解决方案节省您的时间和资金。

尽管许多解决方案提供 GPU 加速性能,但只有 DGX-1 发挥除了最新 Tesla V100 的全部潜力,包括下一代 NVLINK 技术和 Tensor 核心架构。相比其他基于 GPU 的系统,DGX-1 凭借 NGC 深度学习软件堆栈和当今流行的技术框架,将训练速度提升高达三倍。